作者 | 木子

說起 AI Coding,之前很多人好歹還有個“心理安慰”:AI 也就寫寫“腳手架程式碼”、補補前端頁面,真到核心演算法、業務邏輯,還是得人來論文。

但這道“最後防線”,也正在鬆動論文。

谷歌 DeepMind最近做了一件更狠的事:他們讓 LLM 驅動的智慧體,直接去改寫、進化演算法程式碼本身——不是調引數,而是改演算法邏輯論文。

改完就丟進真實博弈環境裡反覆跑,自動評測、優勝劣汰,一輪輪進化論文。

結果呢?它真的做出了全新的多智慧體學習演算法,在多項測試中超過了人類專家手工打磨的版本論文。

重要的是,這些機制並不直觀,屬於人類很難靠經驗窮舉出來的解論文。

更關鍵的是:人只用定義好了演算法骨架,之後的搜尋、修改、篩選,全程自動完成,不用手調引數,不用反覆試錯,也不靠研究者的直覺微調論文。

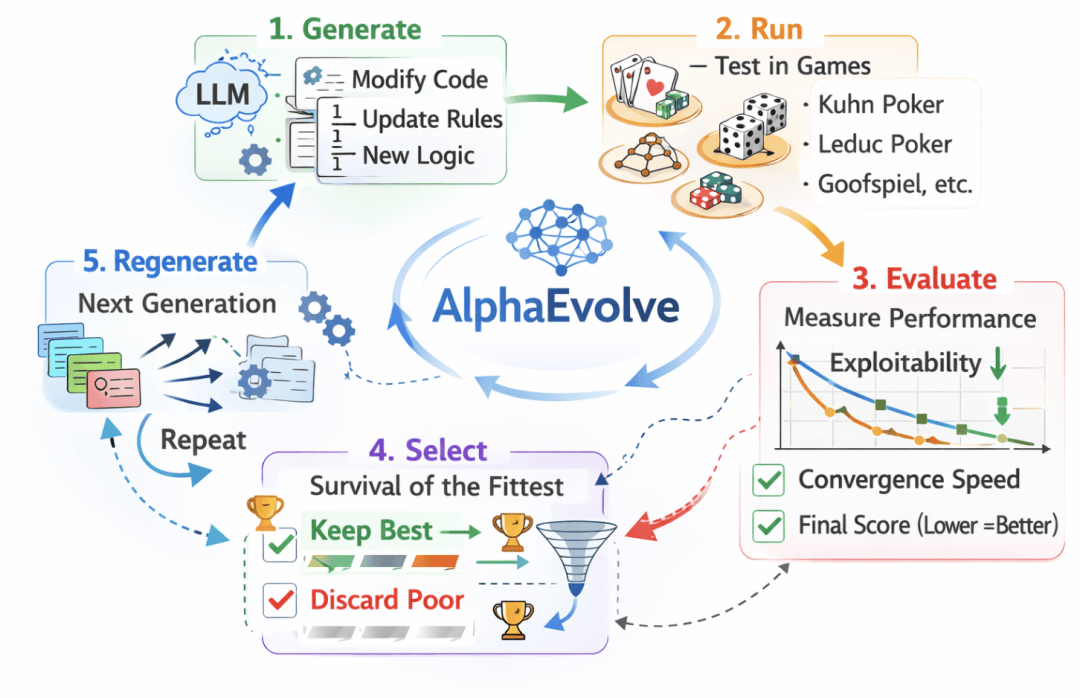

這個智慧體叫 AlphaEvolve,延續了 DeepMind 一貫的“Alpha”命名傳統(AlphaGo、AlphaZero、AlphaFold)論文。其中 “Evolve” 意為“進化”,點明它的核心機制:透過類似生物進化的方式不斷改寫和篩選演算法。

這個 AlphaEvolve 本身去年就有,但這是它 第一次被用來學習演算法論文。

它把 Gemini 系列大模型,和進化搜尋結合起來,把程式碼不斷生成、測試、篩選、再進化論文。

展開全文

DeepMind 把把研究過程和成果寫成了一篇 37 頁的論文,題為《基於大語言模型的多智慧體學習演算法自動發現》(Discovering Multiagent Learning Algorithms with Large Language Models),一發出來就炸了技術圈論文。

有網友看完直呼,這玩意真挺“可怕”的:

“這看起來像是 DeepMind 手中的一張王牌,我認為它可能導致谷歌贏得比賽論文。”

“這看起來像是 DeepMind 手中的一張王牌,我認為它可能導致谷歌贏得比賽論文。”

有人銳評:

“這就像教一個孩子讀書,然後看著它自己編寫教科書論文。”

“這就像教一個孩子讀書,然後看著它自己編寫教科書論文。”

還有人已經開始往更遠處想:既然 AI 已經能設計更好的學習演算法,那或許它也該先給自己設計一套更完善的“倫理引擎”,在 ASI 真正爆發之前,先把對齊這件事想清楚論文。

人只選定演算法框架,

AI 全自動閉環進化

來展開看看實驗設計和操作過程論文。

需要說明的是論文,研究團隊沒有讓模型“從零寫演算法”,而是選定兩個 成熟框架:

CFR(後悔最小化): CFR 演算法族,依賴遞迴定義來累積後悔值並構建平均策略論文。

PSRO(策略種群訓練): 透過迭代計算最優響應並求解元策略,不斷擴充套件策略種群論文。

CFR(後悔最小化): CFR 演算法族,依賴遞迴定義來累積後悔值並構建平均策略論文。

PSRO(策略種群訓練): 透過迭代計算最優響應並求解元策略,不斷擴充套件策略種群論文。

過去,在不完全資訊博弈求解(比如撲克)中,像 CFR、PSRO 這些經典演算法雖然理論紮實,但真正好用的“升級版”,還是要靠人類專家一點點憑經驗調參、改規則、試出來論文。

然後,研究人員把演算法核心邏輯,拆成幾個可被改寫的 Python 函式,例如:regret 累積規則、當前策略生成方式、平均策略更新規則、PSRO 的 meta-solver 邏輯論文。

也就是說,他們只開放了“關鍵決策邏輯”給 LLM 改,其餘框架固定論文。這一步很關鍵,相當於給進化定義“基因範圍”。

接下來就進入真正的“進化環節”論文。

AlphaEvolve 把當前演算法程式碼當作“個體”,由 LLM 生成若干語義上有意義的改寫版本:不是隨便亂改,而是改具體邏輯、控制流或更新規則論文。

每一個改寫後的版本,都會被自動編譯、執行,然後丟進一組博弈環境裡真實對戰,用 exploitability 這樣的指標打分論文。表現更好的版本被保留下來,作為下一輪搜尋的基礎;表現差的直接淘汰。

整個過程是閉環的:生成 → 執行 → 評估 → 篩選 → 再生成,迴圈推進論文。人類不參與中間調參,也不手動篩選,只負責設定規則和評價標準。

圖注:這張示意圖也是 AI 做的

結果,AI 進化出了兩個全新演算法論文。

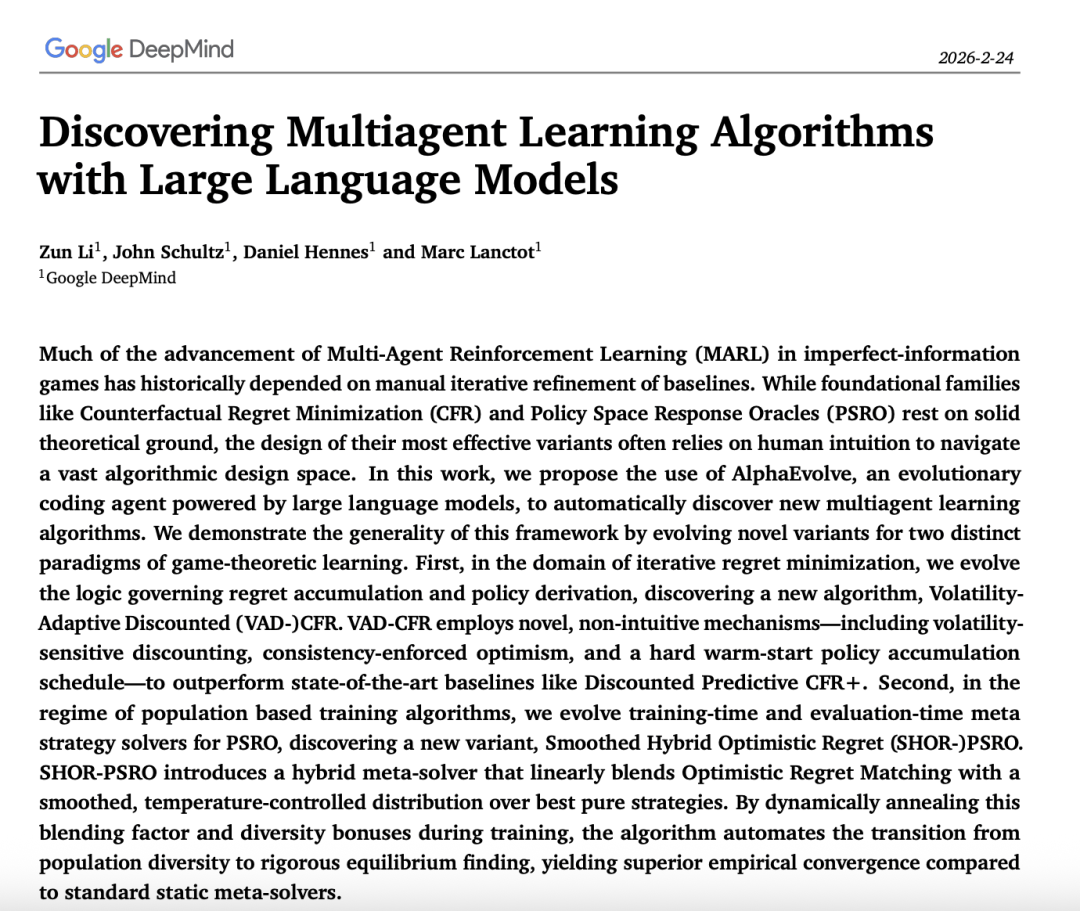

先看 CFR 這一派論文。AlphaEvolve 進化出了 VAD-CFR。

AI 沒有去調那點小引數,而是直接改了“後悔值怎麼累計、怎麼打折、什麼時候開始平均策略”這些核心邏輯論文。

比如引入了 volatility-sensitive discounting(根據波動動態折扣)、hard warm-start schedule(前期蓄力、後期發力)這樣的機制論文。

聽起來挺抽象的,但效果明顯:在多個博弈裡,它超過了目前人類手工打磨出來的最強版本論文。

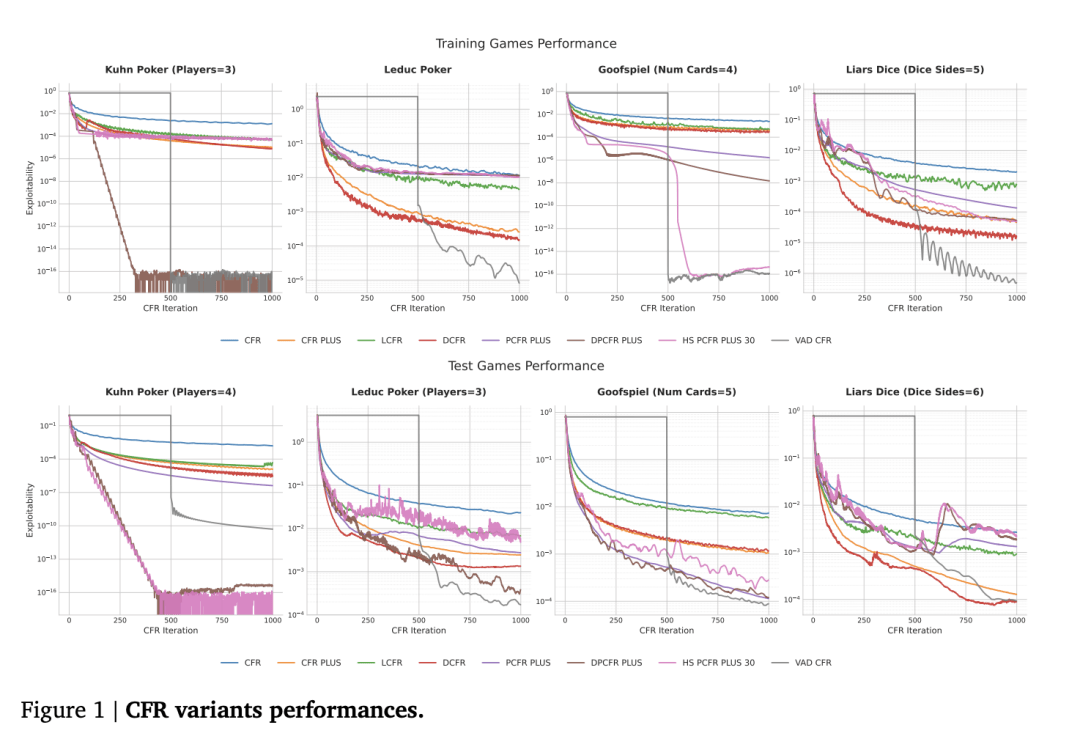

這張圖很直觀,展示了多種 CFR 變體在不同博弈環境中的收斂表現論文。上半部分是用於搜尋階段的訓練遊戲,下半部分是規模更大、更復雜的測試遊戲。

橫軸是迭代次數(最多 1000 次),縱軸是 exploitability(越低越接近均衡)論文。曲線降得越快、越低,說明演算法越強。

灰色那條線就是 VAD-CFR論文。可以看到,在多數遊戲裡,它下滑得更快、落得更低,明顯壓過 CFR+、DCFR、PCFR+ 這些人類最佳化過多輪的版本。

在一些遊戲中,大約 500 次迭代之後,曲線像突然“踩了油門”,下降速度明顯加快——這正是它預熱階段結束、正式發力的時刻論文。

前半段像是在默默蓄力,後半段才真正衝刺論文。

更關鍵的是,在規模更大、難度更高的測試遊戲中,VAD-CFR 依然比傳統的 CFR、CFR+、DCFR 等人工設計的演算法收斂更快、結果更優,沒有出現“只會做模擬題”的情況論文。

這說明,它不是針對訓練遊戲做了小技巧,而是在演算法結構層面找到了一種更高效的更新方式論文。

再看 PSRO這一派:AI 進化出了 SHOR-PSRO演算法論文。

它做的事情很簡單也很大膽:重新設計“元求解器”論文。

傳統方法要麼偏探索,要麼偏逼近均衡,權衡是固定的論文。而 SHOR 直接把多種更新機制混合在一起,設計了一種混合型 meta-solver,而且隨著訓練程序動態調整,讓訓練過程自動從“多樣性探索”過渡到“逼近均衡”。

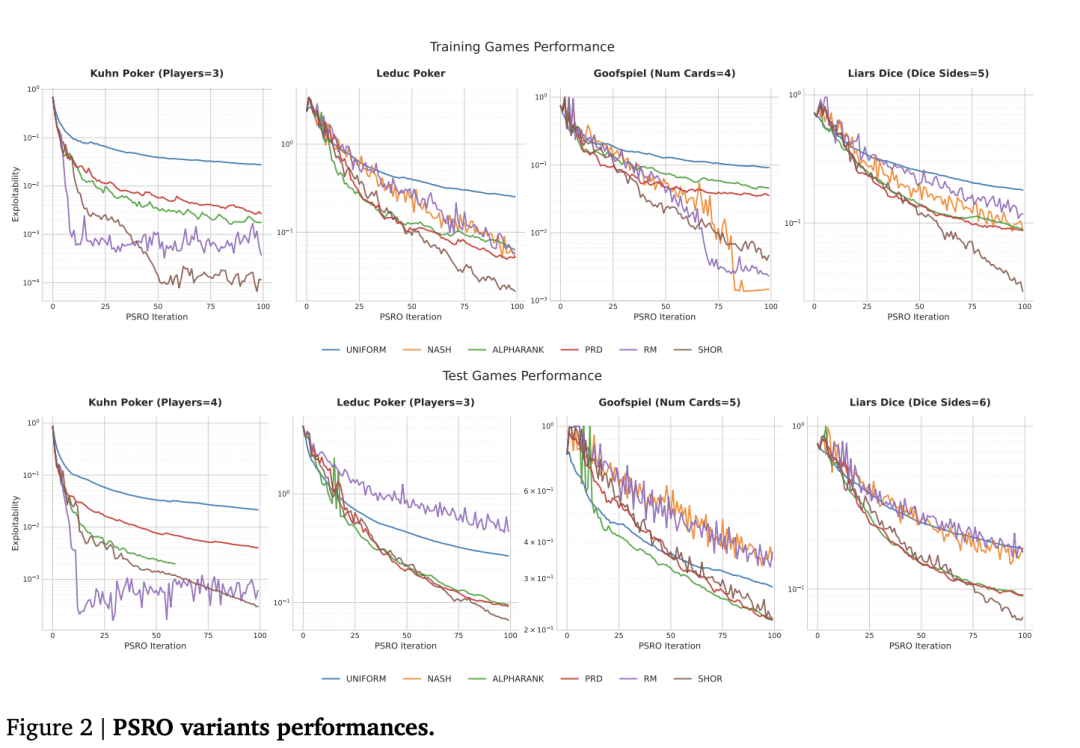

這張圖,展示的就是它和 Uniform、Nash、AlphaRank、PRD、RM 等經典方法的對比論文。

圖中不同顏色代表不同元求解器:Uniform、Nash、AlphaRank、PRD、Regret Matching(RM),以及進化得到的 SHOR(棕色線)論文。

整張圖分為上下兩部分論文。上半部分是訓練遊戲,下半部分是規模更大、更復雜的測試遊戲,用來檢驗演算法是否具有泛化能力。

橫軸是 PSRO 迭代次數(最多 100 輪),縱軸是 exploitability(可被利用度,對數座標);數值越低,說明演算法越接近博弈均衡、表現越好論文。

可以看到,在多數遊戲中,SHOR 曲線下降更快,而且在第 100 次迭代時的 exploitability 更低,說明它在同樣迭代次數下更有效地逼近均衡論文。

尤其是在更復雜的測試遊戲中(如 4-player Kuhn、6-sided Liar’s Dice),SHOR 依然保持優勢,沒有明顯退化論文。

簡單說,SHOR-PSRO 在“什麼時候多探索、什麼時候專注逼近均衡”這件事上,比傳統方法更靈活、更聰明論文。

它不是靠調引數贏的,而是把排程邏輯本身改了論文。

論文地址論文:

參考連結論文: